Thỏa thuận TPU của Meta với Google: Ý nghĩa đối với Nvidia

TradingKey - Theo tin tức từ The Information vào thứ Năm, dẫn lời các nguồn tin thân cận với vấn đề này, Meta Platforms Inc. (META) và Alphabet Inc. (GOOGL) đã đạt được thỏa thuận hợp tác chip AI kéo dài nhiều năm, trị giá hàng tỷ USD, theo đó Meta sẽ thuê các TPU (Tensor Processing Units - đơn vị xử lý Tensor) được Google thiết kế riêng để cung cấp sức mạnh tính toán cho việc đào tạo và suy luận các mô hình lớn thế hệ tiếp theo của mình. Thỏa thuận này đảm bảo khả năng tiếp cận lâu dài, ổn định với công suất TPU cho Meta và xác nhận sự giao thoa ngày càng sâu sắc giữa hai trong số những công ty quyền lực nhất trong nền kinh tế AI.

Giai đoạn thứ hai có thể khiến thỏa thuận này trở nên lớn hơn nữa. Bắt đầu sớm nhất vào năm 2027, Meta có thể trực tiếp mua chip TPU để trang bị cho các trung tâm dữ liệu của riêng mình — một động thái sẽ đưa Google tiến xa hơn vào thị trường cơ sở hạ tầng AI bên ngoài.

Chỉ vài tuần trước đó, Meta đã tuyên bố kế hoạch mua “hàng triệu” đơn vị NVIDIA Corp. (NVDA) GPU để đào tạo dòng mô hình Llama của mình. Giờ đây, việc đổ hàng tỷ USD vào việc thuê TPU có thể giống như việc “bắt cá hai tay”. Trên thực tế, điều này nhấn mạnh mức độ mãnh liệt của nhu cầu AI. Phần cứng của NVIDIA vẫn là động cơ chính cho việc đào tạo, nhưng nguồn cung đang thắt chặt, thời gian chờ đợi kéo dài và giá cả cao ngất ngưởng. Bất kỳ sự gián đoạn nào ở thượng nguồn cũng có thể làm đóng băng toàn bộ lộ trình sản phẩm. Không một nhà phát triển mô hình lớn nào có thể chấp nhận rủi ro khi dồn toàn bộ khối lượng công việc của mình vào một nhà cung cấp duy nhất.

Nói cách khác, thỏa thuận này không làm suy yếu NVIDIA mà chỉ làm nổi bật nhu cầu tính toán AI hiện tại đã trở nên to lớn như thế nào. Meta hiện phải xây dựng một hệ thống đa dạng kết hợp GPU của NVIDIA, TPU của Google và có khả năng là các lựa chọn khác nếu hy vọng bắt kịp các tham vọng AI của chính mình.

“Quý bùng nổ, cổ phiếu sụt giảm” của NVIDIA

Lùi dòng thời gian lại một bước và tác động sẽ trở nên rõ ràng hơn: thông báo về TPU được đưa ra trong tuần báo cáo kết quả kinh doanh của NVIDIA, làm khuếch đại các phản ứng của thị trường. NVIDIA vừa công bố một báo cáo gần như không tì vết khác — cả doanh thu và EPS đều vượt kỳ vọng, và triển vọng cho quý tới lại tiếp tục lạc quan. Công ty dự kiến doanh số đạt 76,4 – 79,6 tỷ USD, với mức trung bình cao hơn nhiều so với ước tính đồng thuận là 72,8 tỷ USD — một lời nhắc nhở rõ ràng rằng “con tàu AI vẫn đang tăng tốc”.

Tuy nhiên, các nhà đầu tư đã phản ứng khác đi. Sau khi kết quả được công bố, cổ phiếu của NVIDIA đã giảm 5,4% trong một phiên duy nhất. Vấn đề không nằm ở hiệu suất; mà là do “kỳ vọng đã tăng đến mức gần như không thể mở rộng thêm”. Cuộc tranh luận không còn là liệu NVIDIA có mạnh hay không, mà là liệu các gã khổng lồ công nghệ như Microsoft Corp. (MSFT), Meta và Amazon.com Inc. (AMZN) có thể — hoặc sẵn lòng — duy trì nhịp độ đầu tư AI theo kiểu “chi tiêu bằng mọi giá” hiện tại hay không. Câu hỏi thứ hai là liệu những khoản chi tiêu vốn (capex) khổng lồ này có thể tạo ra lợi nhuận hợp lý hay sẽ phát triển thành một bong bóng chi tiêu vốn cần phải phanh lại.

Trong bối cảnh đó, ngay cả một triển vọng rực rỡ cũng không thể ngăn chặn sự hoài nghi. Khi sự lạc quan phổ biến bắt đầu rạn nứt, định giá tất yếu sẽ sụt giảm. Tin tức về thỏa thuận TPU của Meta đến cùng lúc, thúc đẩy quan điểm rằng “Meta đang chuyển sang chip của Google — thời kỳ độc quyền của NVIDIA đang kết thúc”. Về mặt tâm lý, điều đó càng củng cố nỗi lo sợ rằng NVIDIA đang chuyển dịch từ vị thế *duy nhất* sang chỉ còn là *một trong số nhiều* lựa chọn, làm trầm trọng thêm đà giảm sau báo cáo lợi nhuận.

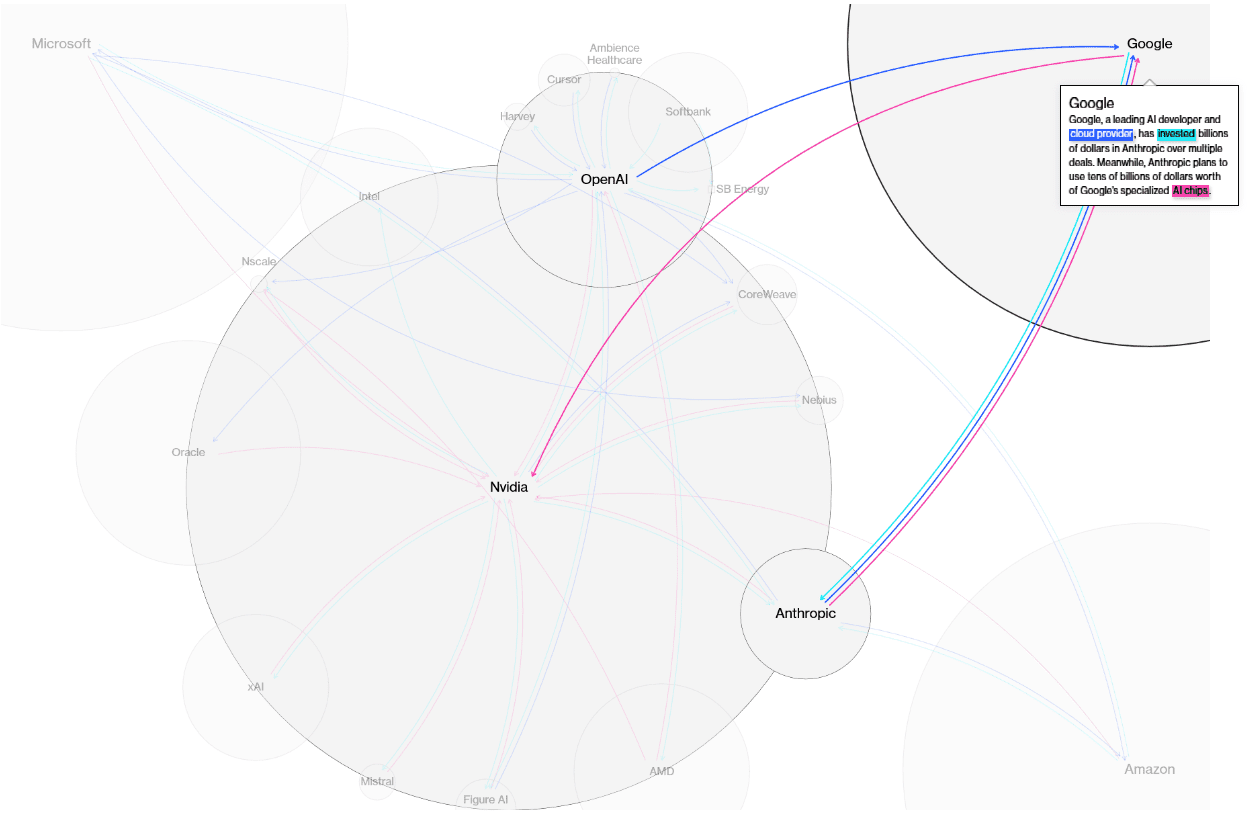

NVIDIA vẫn là cốt lõi của sự bùng nổ AI; Nguồn: Bloomberg

Đây là một chiến thắng cho Google

Đối với Google, giao dịch này không chỉ dừng lại ở một hợp đồng lớn. Trong hai năm qua, các dòng tiêu đề về công ty chủ yếu tập trung vào khả năng phòng thủ — liệu họ có thể chống lại sự gián đoạn từ các đối thủ cạnh tranh mới về tìm kiếm và mô hình hay không. Giờ đây, bằng cách phát hành Gemini đồng thời bán dung lượng đám mây TPU cho một đối thủ như Meta, Google đang kể một câu chuyện khác: họ đã quay trở lại thế tấn công.

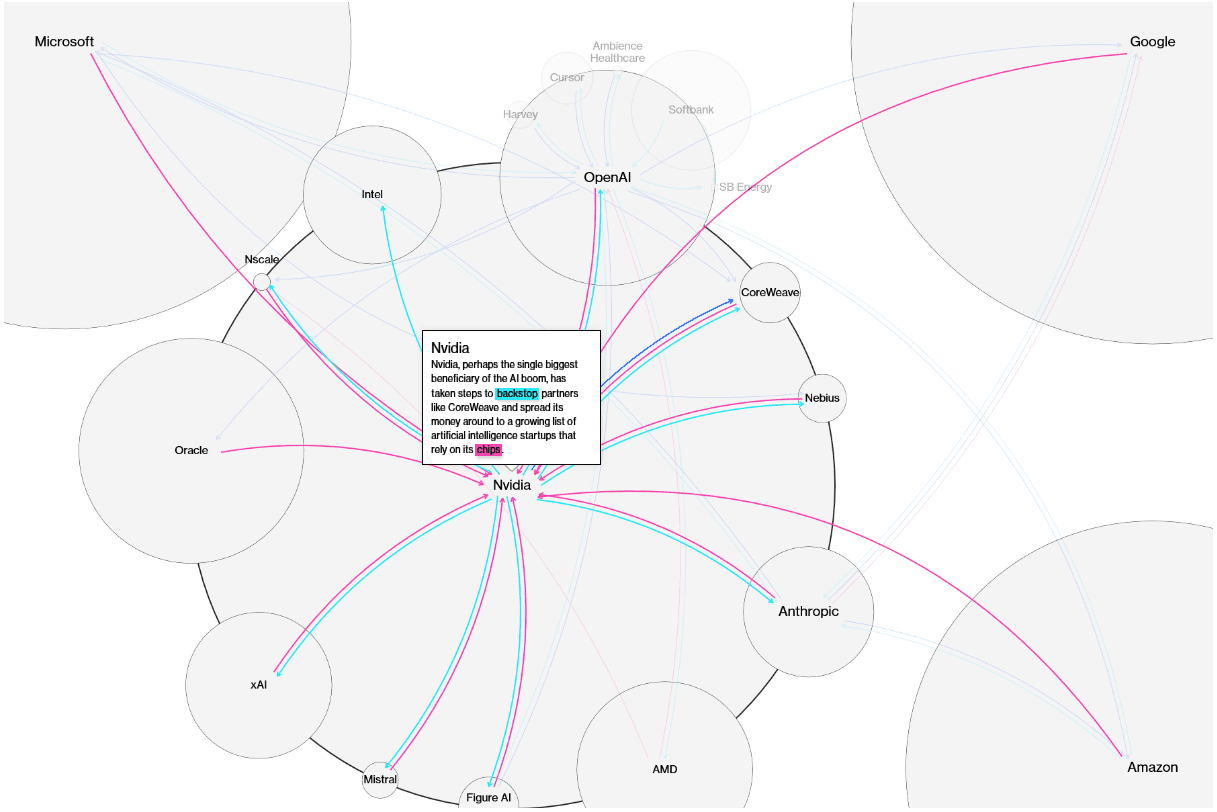

Các chip TPU của Google bắt đầu được cung cấp ra bên ngoài; Nguồn: Bloomberg

Mối quan hệ hợp tác này cũng đánh dấu sự thương mại hóa thực sự của các TPU. Những gì bắt đầu như một cơ sở hạ tầng nội bộ giờ đây đang trở thành một dòng sản phẩm bán ra bên ngoài có biên lợi nhuận cao. Việc cho các gã khổng lồ bên ngoài thuê công suất TPU không chỉ làm tăng doanh thu của Google Cloud mà còn củng cố vai trò của họ trong “chuỗi cung ứng tính toán AI”, đưa họ vào thế cạnh tranh trực tiếp với NVIDIA, Advanced Micro Devices Inc. (AMD), và các nhà cung cấp dịch vụ đám mây quy mô lớn (hyperscaler) khác đang phát triển chip độc quyền.

Trong cùng một làn sóng AI, Google đại diện cho câu chuyện về “độ dốc mới”, trong khi NVIDIA phải đối mặt với câu chuyện về “liệu có thể duy trì độ cao này trong bao lâu”. Thị trường có xu hướng tưởng thưởng cho vế trước bằng một mức định giá thặng dư theo tâm lý ngắn hạn.

Ý nghĩa đối với các nhà đầu tư

Từ góc độ giao dịch, bài học rút ra rất đơn giản. Trong ngắn hạn, dòng vốn đang hướng tới các công ty có thể kể những câu chuyện tăng trưởng mới mẻ — ở đây là Google. Trong khi đó, NVIDIA đang chuyển đổi từ một huyền thoại không thể chạm tới thành một cường quốc vẫn nắm giữ vị thế thống trị nhưng được định giá ở mức bình thường hơn.

Từ góc độ ngành, hợp đồng này báo hiệu rằng tổng thị trường tính toán AI đang mở rộng chứ không phải là sự luân chuyển đơn thuần. Việc Meta sẵn sàng mua GPU của NVIDIA đồng thời thuê TPU của Google cho thấy sự lạc quan chứ không phải là một mâu thuẫn. Việc duy trì nhiều hệ thống phần cứng và phần mềm rất tốn kém; việc thực hiện điều đó chỉ có ý nghĩa nếu Meta tin rằng nhu cầu AI trong tương lai sẽ bù đắp được chi phí. Không một nhà cung cấp đơn lẻ nào có thể đáp ứng được nhu cầu về thông lượng của các công ty dẫn đầu về AI trên toàn cầu nữa — bản thân chiếc bánh đang tăng trưởng nhanh hơn thị phần của bất kỳ công ty nào.

Do đó, các nhà đầu tư nên chuyển trọng tâm từ việc hỏi liệu NVIDIA có bị thay thế hay không sang việc xem xét thị trường phần cứng AI tổng thể có thể lớn đến mức nào, và thị phần mà mỗi nhà cung cấp lớn — NVIDIA, bộ phận TPU của Google, AMD và các bên khác — có thể chiếm lĩnh là bao nhiêu.

Cuối cùng, câu chuyện thực sự đơn giản hơn: cuộc đua cạnh tranh về AI đang buộc mọi nền tảng lớn phải mở rộng nguồn tính toán và xây dựng hệ sinh thái đa nhà cung cấp. Đối với quỹ đạo dài hạn của ngành, sự tiến hóa đó quan trọng hơn nhiều so với những biến động hàng tuần của bất kỳ mức giá cổ phiếu riêng lẻ nào.