Jensen Huang gửi lời cảm ơn. Liệu Samsung có phải là cái tên thắng lớn nhất tại sự kiện Nvidia GTC?

TradingKey - Tại hội nghị NVIDIA GTC 2026, sự hợp tác sâu rộng giữa Samsung Electronics và NVIDIA ( NVDA) đã trở thành tâm điểm chú ý của toàn ngành.

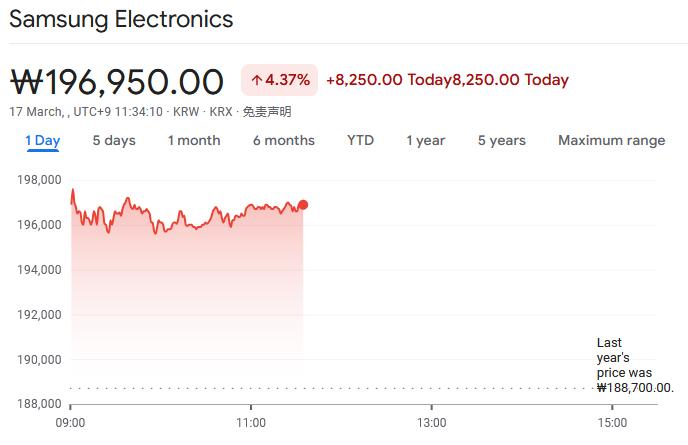

Hai bên không chỉ đạt được những bước đột phá trong lĩnh vực đúc chip mà còn đang hợp tác trên nhiều phương diện, bao gồm công nghệ bộ nhớ và kiến trúc hệ thống, để cùng thúc đẩy quá trình chuyển đổi công nghiệp trong kỷ nguyên suy luận AI. Sự hợp tác này cũng thúc đẩy giá cổ phiếu của Samsung Electronics tại Hàn Quốc tăng hơn 4% trong phiên giao dịch thứ Ba sau thông báo này.

NVIDIA lần đầu tiên thuê Samsung đúc chip LPX

Tại hội nghị lần này, NVIDIA đã chính thức ra mắt hệ thống rack suy luận LPX dựa trên công nghệ của Groq. Sản phẩm này áp dụng kiến trúc "suy luận tách biệt" (disaggregated inference), chia quy trình suy luận AI thành hai giai đoạn: nạp dữ liệu (prefill) và tạo mã thông báo (token generation), lần lượt do GPU Rubin và chip Groq LPU xử lý.

Trong đó, chip LP30 cốt lõi của Groq được sản xuất bởi Samsung Electronics, đánh dấu lần đầu tiên NVIDIA trao đơn đặt hàng chip máy chủ cho một nhà sản xuất khác ngoài TSMC ( TSM ).

Trong bài phát biểu then chốt của mình, Jensen Huang đã gửi lời cảm ơn đặc biệt tới Samsung: "Cảm ơn Samsung đã nỗ lực hết mình để sản xuất chip Groq 3 LPU; việc mở rộng công suất của họ đã vượt xa kỳ vọng", qua đó xác nhận công khai mối quan hệ hợp tác sâu sắc giữa hai công ty trong lĩnh vực đúc chip.

Về cấu hình phần cứng, một tủ rack LPX đơn lẻ có thể chứa 256 chip LP30, trong khi một hệ thống Vera Rubin NVL72 tương ứng với một tủ rack LPX (tỷ lệ GPU trên LPU là 72:256).

Theo dự báo nhu cầu thị trường, nếu 100.000 tủ rack LPX được triển khai trên toàn cầu, mảng kinh doanh đúc chip của Samsung dự kiến sẽ tạo ra doanh thu gần 10 tỷ USD. So với mức 1.000 - 2.000 USD phí dịch vụ đúc chip mà TSMC cung cấp cho một GPU Rubin duy nhất, tổng giá trị kinh doanh mà Samsung đạt được thông qua việc sản xuất chip LPX và cung cấp HBM, DRAM đi kèm có thể gấp ba đến bốn lần TSMC.

Bước nhảy vọt về hiệu suất của HBM4E

Cùng ngày, Samsung Electronics cũng lần đầu tiên trưng bày công khai các chip vật lý và tấm wafer cốt lõi của dòng bộ nhớ băng thông cao thế hệ tiếp theo, HBM4E, tại gian hàng GTC của mình, cho thấy sự cộng hưởng sâu sắc với NVIDIA trong lĩnh vực lưu trữ AI.

Lãnh đạo mảng kinh doanh bộ nhớ của Samsung cho biết công ty sẽ tận dụng quy trình DRAM lớp 10nm thế hệ thứ sáu được tích lũy từ việc sản xuất hàng loạt HBM4, cùng với khả năng thiết kế die đế 4nm để đẩy nhanh quá trình thương mại hóa HBM4E. Các mẫu thử nghiệm dự kiến sẽ được cung cấp cho khách hàng toàn cầu vào nửa cuối năm nay.

Tại hội nghị này, Samsung là nhà sản xuất bộ nhớ duy nhất trưng bày công khai các sản phẩm HBM thế hệ tiếp theo, một động thái được coi là nhằm nới rộng khoảng cách kỹ thuật với các đối thủ như SK Hynix và Micron trong cuộc đua bộ nhớ AI.

Ngoài HBM4E, Samsung còn giới thiệu công nghệ Hybrid Copper Bonding (HCB). So với công nghệ Thermal Compression Bonding (TCB) truyền thống, công nghệ HCB có thể giảm nhiệt trở 20% và hỗ trợ xếp chồng chip từ 16 lớp trở lên, đặt nền móng cho việc nâng cao hiệu suất trong các sản phẩm HBM thế hệ tiếp theo.

Samsung nhấn mạnh rằng các hệ thống AI mạnh mẽ là chìa khóa để thúc đẩy đổi mới trong ngành và hãng sẽ tiếp tục cung cấp các giải pháp bộ nhớ hiệu suất cao cho nền tảng Vera Rubin của NVIDIA.

Tại gian hàng của mình, Samsung đã thiết lập một "Phòng trưng bày NVIDIA" riêng biệt để làm nổi bật các thành tựu hợp tác của cả hai bên trong lĩnh vực lưu trữ, bao gồm HBM4, mô-đun bộ nhớ máy chủ SOCAMM2 và ổ cứng SSD PM1763.

Trong số đó, SOCAMM2 là mô-đun bộ nhớ máy chủ tiết kiệm điện được sản xuất hàng loạt đầu tiên trong ngành, kết hợp băng thông cao với khả năng tích hợp hệ thống linh hoạt; SSD PM1763 sử dụng giao diện PCIe 6.0 để cung cấp khả năng truyền dữ liệu tốc độ cao và hỗ trợ lưu trữ dung lượng lớn cho các ứng dụng AI.

Chiến lược điện toán AI đa kịch bản của Samsung

Đồng thời, Samsung đã trình diễn sơ đồ bố trí toàn diện của mình trong lĩnh vực điện toán AI tại hội nghị, bao phủ các kịch bản từ thiết bị đầu cuối đến trung tâm dữ liệu.

Đối với kịch bản thiết bị cá nhân, Samsung đã trưng bày các sản phẩm NAND PM9E3 và PM9E1 trang bị cho NVIDIA DGX Spark, cũng như các giải pháp DRAM LPDDR5X và LPDDR6 cho điện thoại thông minh và máy tính bảng cao cấp. Đáng chú ý, LPDDR6 tăng băng thông lên 30 - 35 Gbps trên mỗi chân cắm và giới thiệu khả năng điều chỉnh điện áp thích ứng cũng như kiểm soát làm mới động để hỗ trợ hiệu suất cho các khối lượng công việc AI trên thiết bị thế hệ tiếp theo.

Trong lĩnh vực trung tâm dữ liệu, ổ cứng SSD PM1753 của Samsung, với tư cách là một phần của kiến trúc tham chiếu cho hạ tầng lưu trữ tăng tốc của nền tảng NVIDIA Vera Rubin, có thể nâng cao hiệu quả năng lượng và hiệu suất hệ thống cho các tác vụ suy luận.

Ngoài ra, Samsung còn giới thiệu kết quả hợp tác với NVIDIA trong việc phát triển nhà máy AI. Hai bên kế hoạch đưa công nghệ điện toán tăng tốc của NVIDIA vào để mở rộng quy mô các nhà máy AI của Samsung và đẩy nhanh việc triển khai bản sao kỹ thuật số trong sản xuất dựa trên thư viện NVIDIA Omniverse.

Với sự phát triển nhanh chóng của thị trường AI, sự hợp tác sâu rộng giữa Samsung và NVIDIA được kỳ vọng sẽ mang lại sự tăng trưởng kinh doanh bền vững và động lực cho đổi mới công nghệ.