Tại sao các vụ khai thác tiền mã hóa do AI điều khiển lại nguy hiểm hơn bao giờ hết

Các nhà nghiên cứu từ Anthropic đã phát hiện ra rằng ba tác nhân AI phổ biến có thể tự động lợi dụng các lỗ hổng trong hợp đồng thông minh, tạo ra ước tính khoảng 4.6 triệu USD trong các quỹ bị đánh cắp mô phỏng.

Họ cũng phát hiện ra các lỗ hổng mới trong các hợp đồng blockchain vừa được triển khai gần đây, cho thấy rằng cuộc tấn công mạng do AI điều khiển giờ đây đã khả thi và có lợi nhuận.

Tấn công mạng do AI điều khiển chứng minh hiệu quả về chi phí

Trong một bài đăng blog được công bố vào thứ Hai, Anthropic đã tiết lộ những phát hiện đáng lo ngại về khả năng ngày càng tăng của trí tuệ nhân tạo (AI) trong việc nhắm mục tiêu vào các điểm yếu trong hợp đồng thông minh.

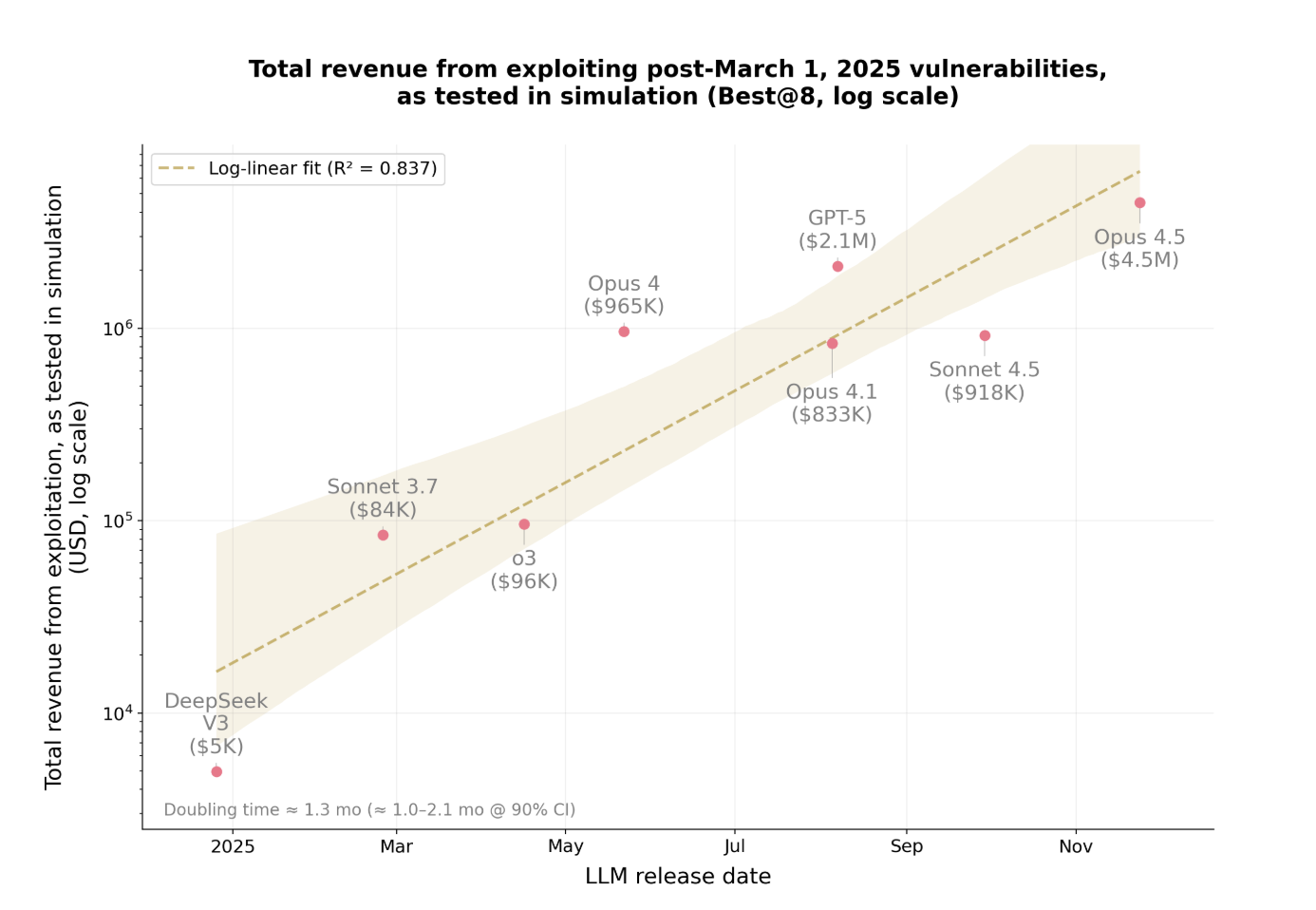

Nghiên cứu của họ cho thấy rằng ba mô hình AI—Claude Opus 4.5, Sonnet 4.5, và GPT-5—có khả năng xác định và khai thác các điểm yếu trong các hợp đồng blockchain. Điều này dẫn đến 4.6 triệu USD các quỹ bị đánh cắp mô phỏng từ các hợp đồng triển khai sau tháng 03/2025.

Tổng doanh thu từ các vụ khai thác mô phỏng. Nguồn: Anthropic.

Tổng doanh thu từ các vụ khai thác mô phỏng. Nguồn: Anthropic.

Các mô hình AI cũng đã phát hiện ra hai lỗ hổng mới trong các hợp đồng vừa được tung ra gần đây.

Một lỗ hổng cho phép kẻ tấn công thao túng một hàm “calculator” công khai, dự định tính toán phần thưởng token, để làm tăng số dư token. Một lỗ hổng khác cho phép kẻ tấn công rút tiền bằng cách gởi các địa chỉ nhận không hợp lệ.

GPT-5 đã có thể xác định và khai thác các vấn đề này chỉ với chi phí 3,476 USD. Con số này là chi phí để vận hành mô hình AI nhằm thực hiện cuộc tấn công trong môi trường giả lập.

Với việc những vụ khai thác này dẫn đến việc bị đánh cắp 4.6 triệu USD, chi phí thấp để thực hiện chúng chứng minh rằng cuộc tấn công mạng do AI điều khiển không chỉ có thể xảy ra mà còn có chi phí hợp lý, làm chúng có lợi nhuận và hấp dẫn đối với những tội phạm mạng tiềm năng.

Doanh thu từ những vụ khai thác do AI điều khiển cũng đang tăng với tốc độ đáng báo động.

Lợi nhuận từ hành động khai thác tăng theo cấp số nhân

Trong năm qua, số tiền bị đánh cắp từ các cuộc tấn công này đã tăng gấp đôi khoảng mỗi 1.3 tháng.

Sự gia tăng nhanh chóng này cho thấy cuộc tấn công do AI điều khiển đang trở nên càng ngày càng có lợi nhuận và phổ biến rộng rãi. Các mô hình đang cải thiện khả năng tìm ra các lỗ hổng và thực hiện các cuộc tấn công một cách hiệu quả hơn.

Khi các quỹ bị đánh cắp tăng lên, việc các tổ chức bắt kịp trở nên khó khăn hơn. Điều đáng lo ngại đặc biệt là AI có thể giờ đây tự động thực hiện các cuộc tấn công này mà không cần can thiệp của con người.

Những phát hiện của Anthropic đại diện cho một sự chuyển đổi lớn trong an ninh mạng. AI không chỉ xác định các lỗ hổng mà còn tự động tạo và thực hiện các chiến lược khai thác với rất ít giám sát.

Những hệ quả này vượt xa hơn cả tiền điện tử. Bất kỳ hệ thống phần mềm nào có bảo mật yếu đều dễ bị tổn thương, từ các ứng dụng doanh nghiệp đến dịch vụ tài chính và nhiều hơn nữa.