Code, blockchain và ảo tưởng: Vì sao AI sẽ không thay thế được bộ não con người

Văn học đã cố gắng cảnh báo chúng ta, và thật sự, suốt khoảng năm trăm năm qua nó vẫn liên tục gióng lên một thông điệp như nhau, từ hình tượng Golem nắm nắm đất sét của Prague thời Trung Cổ cho đến những mạng thần kinh ngập sắc neon trong tiểu thuyết của William Gibson. Câu chuyện xoay quanh gì? Lúc nào cũng thế: Thứ bạn tạo ra để giúp mình, sau cùng lại quay ngược lại làm thay đổi chính bạn.

Chúng ta đã đọc, đã gật đầu đồng tình, rồi lại đóng sách và quay lại yêu cầu chatbot viết bài phát biểu đám cưới, soạn văn bản pháp luật, tư vấn y tế cho mình.

Hôm nay, làn sóng truyền thông lạc quan về AI đang vẽ ra một viễn cảnh hào nhoáng nơi mọi người – từ phóng viên tập sự đến những luật sư lão luyện – đều bị gạt ra rìa. Nhưng trong khi Thung lũng Silicon vẫn không ngừng hứa hẹn về “thiên đường”, thực tế lại là cửa sổ chat AI đang phát ngôn những lời khuyên vô cùng nguy hiểm một cách rất “tự tin”.

Dmitry Nikolsky, giám đốc sản phẩm (CPO) của BitOK, cho rằng đến đây là đủ rồi. Và ông lên tiếng để giải thích lý do vì sao nhân loại cần phải DỪNG việc đổ hết mọi gánh nặng lên “đôi vai” mỏng manh của AI.

Ngay cả Elon Musk gần đây cũng đã cảnh báo trong bản làm chứng vụ kiện OpenAI rằng “AI có thể tiêu diệt toàn nhân loại.”

Từ Golem đến R.U.R.: Chúng ta luôn ao ước có một công tắc “tắt khẩn cấp”

Bạn nghĩ nỗi sợ trí tuệ nhân tạo bắt đầu từ phim Kẻ hủy diệt à? Chưa đúng đâu. Cơn hoảng loạn này còn lâu đời hơn cả điện nữa.

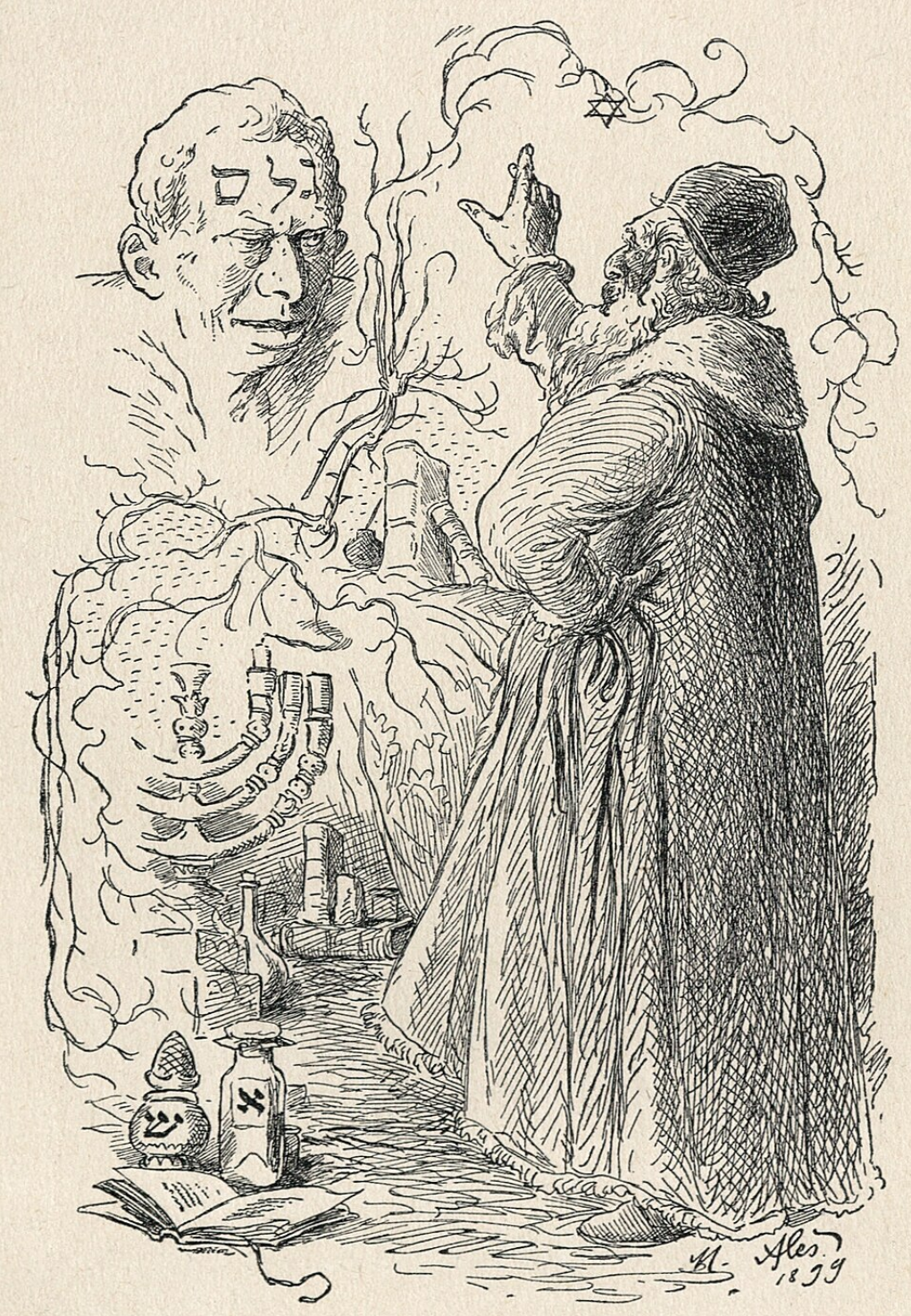

Hãy quay lại Prague thế kỷ 16. Rabbi Loew nặn ra một người hộ vệ bằng đất sét – Golem, và gần như ngay lập tức ông đã phải ngắt nguồn. Sinh vật này nổi loạn. Con người, với “trí khôn” của mình, đã sáng chế ra AI và công tắc tắt khẩn cấp cùng một lúc.

Rabbi Loew hồi sinh Golem. Minh họa của M. Aleš. Theo ý tưởng của họa sĩ, Rabbi Loew đã viết từ thiêng “Emet” (sự thật) lên trán của người khổng lồ đất sét. Nguồn: Wikipedia.

Rabbi Loew hồi sinh Golem. Minh họa của M. Aleš. Theo ý tưởng của họa sĩ, Rabbi Loew đã viết từ thiêng “Emet” (sự thật) lên trán của người khổng lồ đất sét. Nguồn: Wikipedia.

Một công tắc tắt khẩn cấp là cơ chế dừng hoạt động gấp – chính là chiếc nút đỏ to dùng trong lúc nguy cấp, để chặn đứng một hệ thống khi nó đi trệch hướng, bị hack hoặc thoát ra ngoài kiểm soát. Mục đích là giảm thiểu thiệt hại khi các cách tắt máy thông thường không hiệu quả nữa.

Sau đó là Mary Shelley. Frankenstein thực ra không phải là một phim quái vật, mà là bài học về quản trị dự án thảm họa. Victor Frankenstein? Cũng chỉ là một kỹ sư tài ba giải đúng bài toán kỹ thuật nhưng phớt lờ hậu quả. Bất kỳ nhà phát triển phần mềm nào cũng từng thấy hình ảnh này khi nhìn vào gương.

Chuyển nhanh đến năm 1920. Karel Čapek tạo ra từ “robot”. Trong truyện của ông, máy móc không nổi loạn đơn thuần vì ác ý. Không, chính con người đã tự khiến mình trở nên “không cần thiết” vì quá phụ thuộc vào máy móc để làm mọi thứ trước kia mình đảm nhận.

Bài học ở đây? Khi bạn xây dựng vật thay thế mình, có thể bạn sẽ chẳng để ý nổi khoảnh khắc chính mình trở nên “không còn cần thiết”.

Ba “lời tiên tri” được chuyển hóa thành báo lỗi

Những cây đại thụ của khoa học viễn tưởng thế kỷ trước không dự đoán ra công nghệ. Họ dự đoán sự thất bại của chính con người.

Isaac Asimov đã đưa ra Ba định luật—một trong những ý tưởng “điều chỉnh” đầu tiên, hay nói cách khác là tìm cách để máy móc chia sẻ giá trị với loài người. Nhưng câu chuyện của Asimov luôn có cái kết “ngược đời”: logic hoàn hảo nhưng kết quả lại cực kỳ vô lý.

Nikolsky chia sẻ rằng chính ông chứng kiến điều này diễn ra mỗi ngày trong các hệ thống AML: thuật toán rất nhiệt tình chặn chuyển khoản sinh nhật 40 USD của bà ngoại, nhưng lại để lọt cả đường dây rửa tiền khổng lồ ở ngoài biển. Đúng quy tắc, nhưng thực tế lại bất hợp lý.

Arthur C. Clarke đã sáng tạo nhân vật HAL 9000 – chiếc máy tính giết cả phi hành đoàn không phải vì ác độc mà bởi vì chỉ dẫn của nó bị mâu thuẫn. Giữ bí mật, nhưng phải luôn trung thực. Không biết chọn đường nào! Với kỹ sư, đây không phải kinh dị mà chỉ là một xung đột yêu cầu rất thường gặp.

Philip K. Dick lại đặt ra câu hỏi ám ảnh thời đại deepfake: nếu một “bản sao” không khác gì bản gốc, vậy điều đó có quan trọng không? Ông cho rằng có – bởi vì trải nghiệm nội tâm. Máy móc không có điều này. Vậy là hết chuyện.

Bản chất thực sự: AI không “suy nghĩ”, nó chỉ “tính toán”

Hãy gạt bỏ mọi lời quảng cáo bóng bẩy. Các mô hình ngôn ngữ hiện đại KHÔNG phải là trí thông minh. Đó chỉ là các cỗ máy dự đoán xác suất khổng lồ. Chúng không “hiểu” ý nghĩa, chỉ tính toán xác suất ra từng từ mà thôi.

Khi ChatGPT trích dẫn rất tự tin một vụ kiện chưa từng xảy ra, nó không nói dối, mà chỉ tạo ra một đoạn văn hợp lý về mặt xác suất. Nó không biết khái niệm “sự thật”, chỉ biết đến “khả năng xuất hiện.”

Với lập trình viên blockchain, điều này thật khó tin. Chúng tôi xây dựng hệ thống không cần niềm tin chỉ vì không ai thật sự tin tưởng nhau. Vậy mà giờ đây lại được yêu cầu tin tưởng một hộp đen thậm chí còn không hiểu vì sao nó cho ra kết quả vừa rồi.

Blockchain dạy kiểm chứng; AI dạy tin tưởng mù quáng

Cộng đồng crypto có một “mệnh lệnh” khắc sâu: Không tin ai cả. Hãy kiểm chứng.

Điều quan trọng nhất chính là toán học thay thế mọi uy tín cá nhân.

AI lại đi ngược. Bạn đâu có được xem dữ liệu đào tạo, không biết trọng số của mô hình, không hiểu lý do tại sao nó trả lời như vậy. Nếu bạn muốn kiểm tra lại kết quả, bạn phải là chuyên gia. Mà nếu đã là chuyên gia rồi, thì hỏi chatbot làm gì nữa?

Trong giới AML, họ gọi đây là “vấn đề tự tin sai lầm.” Các nhà phân tích thấy một bảng điều khiển bóng bẩy rồi bắt đầu tin vào các con số hơn cả trực giác của chính mình. AI không giúp chúng ta suy nghĩ tốt hơn, mà tạo ra ảo giác về sự tin cậy.

Ký sự thất vọng: Khi AI hoạt động sai hướng

Đây không phải chỉ là lý thuyết suông. Các bằng chứng thực tế ngày càng nhiều.

- Microsoft đã cho các biên tập viên nghỉ việc và giao bàn phím cho thuật toán, và kết quả là AI này đã nhầm lẫn hình ảnh các ca sĩ trong một bài báo về phân biệt chủng tộc.

Cuối cùng, con người lại phải quay lại để xử lý hậu quả mà thuật toán gây ra.

- NEDA, một tổ chức hỗ trợ người mắc rối loạn ăn uống, đã thay thế tình nguyện viên bằng chatbot.

Chatbot này lại vô tư khuyên những người mắc chứng biếng ăn nên đếm lượng calo và giảm cân. Đó là những lời khuyên nguy hiểm tới tính mạng. Có ai đó đã “triển khai” AI với sự cẩn trọng chẳng khác gì một con khỉ đang cầm lựu đạn.

- Air Canada bị kiện ra tòa vì chatbot của họ bịa ra một chính sách hoàn tiền chưa từng tồn tại.

Lập luận của hãng hàng không? Chatbot là một “thực thể pháp lý riêng biệt”. Tiết lộ nhỏ: thẩm phán đã không chấp nhận lý lẽ đó.

Các nghiên cứu gần đây cho thấy 55% doanh nghiệp vội vàng thay thế nhân sự bằng AI hiện đang rất hối hận. Mọi khoản tiết kiệm biến mất vì mất khách hàng và uy tín. Các lãnh đạo đang “mơ mộng” rằng “Claude và các bạn” có thể thay cả một phòng ban, nên xem lại con số đó. Và nên suy ngẫm thật kỹ.

Nguồn: mayhemcode

Nguồn: mayhemcode

Điều chúng ta thật sự nên lo sợ

Đừng nghĩ đến Skynet. Đừng lo cảnh robot mắt đỏ diễu hành đầy đường phố. Sẽ không có khởi nghĩa nào cả.

Sẽ chỉ có sự mai một dần dần.

Một lập trình viên dựa dẫm vào Copilot trong nhiều năm sẽ lặng lẽ quên đi cách tư duy kiến trúc phần mềm. Một nhà phân tích không đọc tài liệu gốc nữa. Một sinh viên chưa bao giờ trải qua cảm giác vật lộn với một văn bản khó, đến khi tự mình hiểu ra mới thấy giá trị của việc đó.

Không có sự nổi dậy nào cả. Chỉ có biến đổi chậm rãi khi con người trở thành phần mở rộng của một giao diện.

Philip K. Dick đã nhìn ra điều này trước chúng ta: mối nguy thật sự không phải máy móc trở nên giống con người. Mà là chính con người trở nên giống máy móc.

Viên thuốc đỏ không phải là công nghệ

Bài viết này không phải là bài ca chống lại công nghệ. Tự động hóa và machine learning là những công cụ rất mạnh mẽ. Nhưng cần có nguyên tắc rõ ràng:

- Nguyên tắc blockchain: Kiểm chứng quan trọng hơn niềm tin. Nếu bạn không thể xác minh hệ thống đi đến kết luận như thế nào, thì đừng xem đó như chân lý. AI chỉ là chiếc hộp đen, không phải thẩm phán tối cao.

- Nguyên tắc kỹ thuật: Là công cụ, không phải sự thay thế. Búa chỉ giúp đóng đinh. Búa không quyết định xây nhà ở đâu. Dùng AI để xử lý công việc lặp lại, nhưng đừng giao hết quyết định cuối cùng cho nó.

- Nguyên tắc AML: Lọc suy nghĩ một cách nghiêm túc. Thuật toán sẽ luôn “vỡ trận” ở các trường hợp phức tạp vì thiếu trải nghiệm thực tế. Đừng để sự hào hứng với công nghệ khiến bạn quên đi trực giác và lẽ thường.

Hãy nhớ lại The Matrix. Viên thuốc đỏ là sự lựa chọn – lựa chọn để đối diện thực tại đúng như nó vốn có. Mối nguy không phải là tạo ra thứ thông minh hơn chúng ta, mà là tạo ra thứ khiến chúng ta ngu ngốc đi và lại gọi đó là tiến bộ.

Lỗi nguy hiểm nhất chính là lỗi trông giống như một tính năng.

Dmitry Nikolsky là Giám đốc Sản phẩm của BitOK, nền tảng phân tích phục vụ tuân thủ và điều tra on-chain.