Vụ kiện của Anthropic với Trump có thể làm biến động cổ phiếu AI và quốc phòng

Anthropic đã kiện chính phủ Mỹ sau khi Lầu Năm Góc liệt công ty này vào diện “rủi ro chuỗi cung ứng”, một động thái có thể định hình lại cách các nhà cung cấp trí tuệ nhân tạo (AI) hợp tác với quân đội. Đơn kiện này thách thức quyết định của chính phủ và đặt ra nhiều câu hỏi về cách các nhà thầu quốc phòng lựa chọn hệ thống AI.

Thị trường hiện đang theo dõi liệu tranh chấp này có tác động dây chuyền đến những công ty liên quan đến hạ tầng AI trong quân sự, bao gồm cả các doanh nghiệp phần mềm như Palantir Technologies và các nhà thầu quốc phòng lớn như Lockheed Martin hay không.

Nhãn dán của Lầu Năm Góc dẫn đến tranh chấp pháp lý

Tranh chấp đã bắt đầu từ đầu tháng này khi Bộ Quốc phòng Mỹ chính thức xếp Anthropic vào diện rủi ro chuỗi cung ứng.

Việc này đồng nghĩa các nhà thầu quốc phòng không được phép sử dụng hệ thống AI của Anthropic trong một số chương trình quân sự nhất định.

Các quan chức Lầu Năm Góc cho rằng, quyết định này là để bảo vệ an ninh quốc gia và đảm bảo các công cụ AI sử dụng trong hệ thống quốc phòng phải đáp ứng tiêu chuẩn nghiêm ngặt về chuỗi cung ứng.

Quyết định này đã lập tức ảnh hưởng đến các nhà thầu tích hợp mô hình AI thương mại vào phần mềm và hệ thống phân tích của quân đội.

Tổng thống Trump yêu cầu các cơ quan liên bang ngừng sử dụng công nghệ AI của Anthropic. Nguồn: Truth Social

Tổng thống Trump yêu cầu các cơ quan liên bang ngừng sử dụng công nghệ AI của Anthropic. Nguồn: Truth Social

Anthropic đã kịch liệt phản đối việc bị xếp loại như vậy. Công ty cho rằng quyết định này thiếu minh bạch và có thể làm mất đi cơ hội của một nhà cung cấp AI lớn trong các dự án của chính phủ.

Ngày thứ Hai vừa qua, Anthropic chính thức nộp đơn kiện nhằm phản đối quyết định của chính phủ.

Theo hồ sơ được gửi lên tòa, công ty này lập luận rằng, Lầu Năm Góc đã hành động mà không có căn cứ rõ ràng và nhãn rủi ro này sẽ ảnh hưởng lớn đến khả năng cạnh tranh khi tham gia các gói thầu của liên bang.

Anthropic đề nghị tòa án yêu cầu đình chỉ hiệu lực của quyết định và buộc chính phủ giải thích lý do an ninh quốc gia cụ thể cho động thái này.

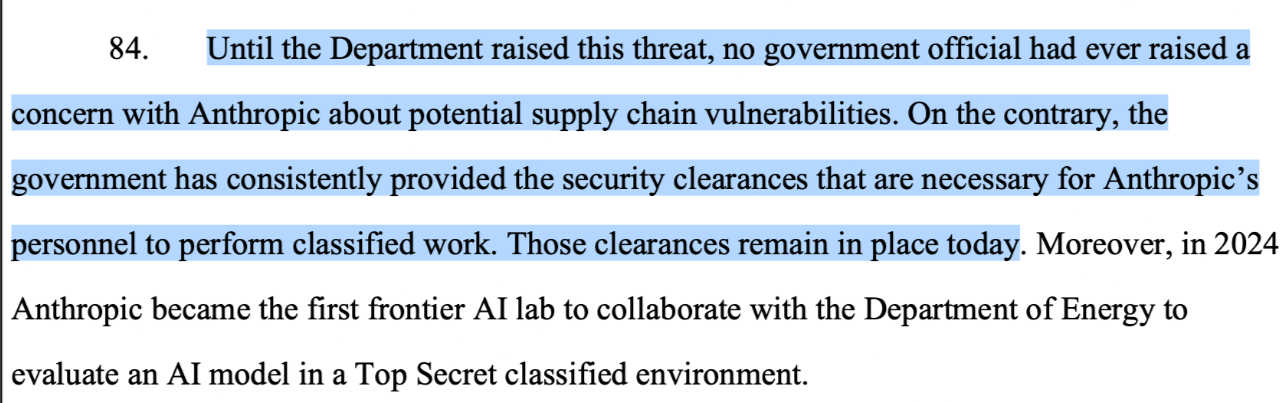

Anthropic khẳng định luôn đảm bảo điều kiện làm việc với các dự án mật của chính phủ

Anthropic khẳng định luôn đảm bảo điều kiện làm việc với các dự án mật của chính phủ

Rủi ro đối với các đối tác công nghệ quốc phòng Mỹ

Cuộc chiến pháp lý này có thể khiến các công ty phụ thuộc vào mô hình AI bên ngoài trong hệ thống phần mềm quốc phòng gặp nhiều rủi ro và bấp bênh hơn.

Một trong những cái tên được quan tâm nhất chính là Palantir Technologies, công ty phát triển các nền tảng phân tích dữ liệu được sử dụng bởi quân đội và các cơ quan tình báo Mỹ.

Nếu mô hình AI của Anthropic bị hạn chế trong các dự án quốc phòng, Palantir và các nhà thầu khác có thể sẽ phải chuyển sang sử dụng dịch vụ của nhà cung cấp AI khác.

Cổ phiếu Palantir biến động mạnh sau khi Anthropic nộp đơn kiện. Nguồn: Google Finance

Cổ phiếu Palantir biến động mạnh sau khi Anthropic nộp đơn kiện. Nguồn: Google Finance

Những thay đổi này có thể làm chậm tiến độ triển khai giải pháp và phải điều chỉnh kỹ thuật. Tuy nhiên, phần lớn các chuyên gia cho rằng các đơn vị phần mềm sẽ ưu tiên thay đổi mô hình thay vì mất hợp đồng với chính phủ.

Đối với các nhà sản xuất quốc phòng lớn, mức ảnh hưởng được đánh giá là thấp hơn.

Lockheed Martin – nhà thầu quốc phòng lớn nhất tại Mỹ, cho biết họ không phụ thuộc vào bất kỳ một nhà cung cấp AI nào. Công ty này nhận định rằng quyết định từ phía Lầu Năm Góc gần như không ảnh hưởng nhiều đến các dự án đang triển khai.

Điều này phản ánh xu hướng chung của ngành công nghệ quốc phòng: các nhà thầu lớn luôn phối hợp với nhiều bên cung cấp để tránh phụ thuộc quá nhiều vào một đơn vị phần mềm duy nhất.

Biểu đồ giá cổ phiếu LMT. Nguồn: Google Finance

Biểu đồ giá cổ phiếu LMT. Nguồn: Google Finance

Cơ hội cho các nhà cung cấp AI đối thủ

Dù vụ kiện khiến tương lai của Anthropic trở nên không chắc chắn, đây lại là cơ hội cho các công ty AI đối thủ.

Nếu Lầu Năm Góc vẫn giữ lệnh hạn chế, các nhà thầu quốc phòng có thể ưu tiên lựa chọn các nhà cung cấp mô hình khác như OpenAI hay các nền tảng điện toán đám mây thuộc Microsoft và Amazon.

Những công ty này hiện đã cung cấp hạ tầng và dịch vụ AI cho nhiều cơ quan chính phủ. Nếu quy trình mua sắm thay đổi, vai trò của họ trong lĩnh vực AI quốc phòng sẽ còn được mở rộng hơn nữa.

Tuy nhiên, hiện tại kết quả vẫn còn phụ thuộc vào phán quyết của tòa án. Nếu Anthropic giành chiến thắng, Lầu Năm Góc có thể sẽ phải điều chỉnh lại hoặc thu hẹp diện áp dụng của nhãn rủi ro chuỗi cung ứng này.

Đối với các nhà đầu tư nhỏ lẻ và các nhà thầu quốc phòng, tranh chấp này cho thấy một vấn đề lớn hơn.

Khi trí tuệ nhân tạo ngày càng trở thành phần cốt lõi trong các hệ thống quân sự, khả năng của chính phủ trong việc phê duyệt hoặc hạn chế các nhà cung cấp AI có thể ảnh hưởng đáng kể đến ngành công nghệ cũng như chuỗi cung ứng trong lĩnh vực quốc phòng.